英伟达掌舵人黄仁勋,在GTC2017上再掀京城“AI风云”。

▲ NVIDIA CEO 黄仁勋

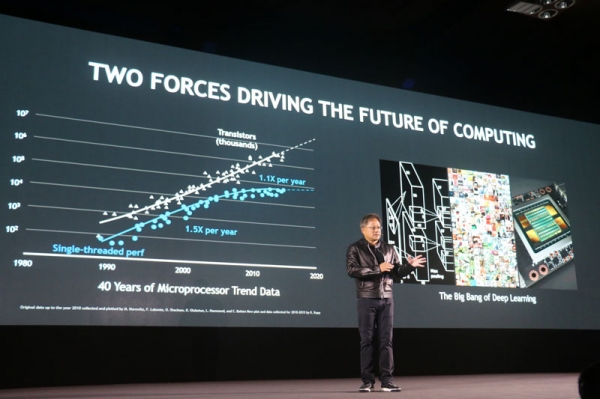

上场后“老黄”直接开怼,终于说出了人们憋在心中许久的结论——摩尔定律已终结。

▲ 两股力量推动计算领域的未来

但,NVIDIA的GPU计算为整个行业指出了前进的道路。

他指出,设计人员无法再创造出可以实现更高之灵系并行性的CPU架构;晶体管数每年增长50%,但CPU的性能每年仅增长10%。而NVIDIA的GPU弥补CPU的不足,加速处理高强度计算负载。

深度学习另一大“杀伤性武器”:CUDA

CUDA是一种革命性的计算架构,它将专用功能ASIC的性能与通用编程模型相结合,使开发人员实现多种算法。目前CUDA开发人员的数量在5年里增长了14倍超过60万,下载量达到180万。

▲ 适用于全球开发人员的NVIDIA AI

AI是NVIDIA CUDA GPU的“杀手级应用”,AI取得惊人进步。

阿里巴巴、百度和腾讯已在各自的云服务中采用NVIDIA Volta GPU。

华为、浪潮和联想已采用NVIDIA基于HGX的GPU服务器。

此外,NVIDIA还在为全球开发员人配置强大AI工具,全力推进“统一架构”CUDA GPU计算。

AI推理是下一个巨大挑战,重磅发布 TensorRT 3

AI推理平台必须具备可编程性,高性能,且支持庞大和复杂的网络。

随着智能机器的爆发性增长,AI会将智能注入到2000万台云服务器、上亿台汽车和制造机器人中。所以,AI推理平台必须可扩展,以解决海量计算的性能、功耗和成本需求。

▲ 宣布NVIDIA TensorRT 3

于是,老黄又来搞事了。

宣布NVIDIA TensorRT 3,全球首款可编程AI推理加速器。

TensorRT是一款适用于CUDA GPU的优化神经网络编译器,它可利用CUDA深度学习指令集创建运行时。从云、数据中心、PC、汽车到机器人,TensorRT皆能在NVIDIA全系列平台便宜出最优运行时。

▲ 运行在 V100上的 TensorRT在处理图像时可实现7ms的延时

运行的Volta上的TensorRT3在图像分类方面,比最快的CPU还要快40倍,在语言翻译方面则要快140倍。

搭配 Tesla V100 GPU 加速器的 TensorRT 每秒能够识别多达 5700 张图片,而如今所用的 CPU 则每秒仅能识别 140 张图片。

AI城市是一个巨大的AI推理挑战,它可能需要使用大约1000万个Tesla V100 GPUs来监控10亿台摄像头。

▲ NVIDIA AI城市-助力中国建设更智慧、更安全的城市

NVIDIA将携手海康威视共建AI城市。此外,大华、华为和阿里巴巴都提供基于NVIDIA平台的AI视频解决方案。